Rapport « Les lumières à l’ère du numérique »

Fausses informations, viralité des contenus de faible qualité, ingérences numériques étrangères… le rapport de la Commission Bronner publié en janvier dernier, décrypte les mécanismes psychosociaux de la désinformation et dresse un état des lieux de ce phénomène qui influence les croyances des usagers sur le web et les réseaux sociaux. Les experts listent aussi 30 recommandations dans le champ de l’éducation, de la régulation et de la lutte contre les diffuseurs de haine en ligne.

Qu’est-ce que la Commission Bronner ?

Le sociologue Gérard Bronner a présidé la commission « Les Lumières à l’ère Numérique ». Lancée par le Président de la République Emmanuel Macron le 29 septembre 2021, cette commission a regroupé 14 experts issus de différentes spécialités tels que des historiens, politologues, juristes, journalistes, enseignants, sociologues, acteurs du monde universitaire ou de la société civile. Leur objectif : mesurer et comprendre les dangers que le numérique fait peser sur la cohésion nationale et notre démocratie afin de mieux y faire face.

Les causes de la désinformation

Les experts relèvent plusieurs causes à la désinformation :

- le profit comme moteur de la désinformation. La publicité dite « programmatique » constitue une source de revenus substantielle pour les artisans de la désinformation. les régies sont capables de pousser des contenus ciblés. Plus une information est choquante, plus elle peut recueillir de clics et de partages.

- la compétition stratégique : l’espace numérique est devenu l’arène de grandes opérations informationnelles avec l’émergence de menaces de plus en plus hybrides. Les grandes puissances investissent massivement dans leurs capacités de lutte informatique pour convaincre l’opinion publique de la légitimité d’une cause, pour obtenir un avantage tactique ou pour influencer l’adversaire ;

- des logiques algorithmiques qui contribuent à former les comportements, les attitudes, les représentations du monde environnant ou les croyances sans en être directement responsables.

» La configuration des réseaux sociaux, où les informations sont noyées dans une masse de contenus de divertissement, ne nous encourage nullement à la vigilance cognitive, rempart pourtant essentiel à la crédulité. »

Rapport Bronner

Pour tenter de ramener de la rationnalité dans les débats, les experts ont donc renseigné une liste de 30 recommandations visant « à limiter la propagation des contenus qui nuisent à la vie démocratique, dissuader les comportements malveillants, sanctionner les pratiques illicites, améliorer la prévention des risques et renforcer la vigilance des utilisateurs ».

Renouer avec l’esprit des Lumières : développer l’esprit critique et l’éducation aux médias

Selon le rapport, « l’Éducation nationale a un rôle essentiel à jouer » pour lutter face à la désinformation en ligne. L’enjeu est de développer l’esprit critique des Internautes exposés à des flots de fausses informations. Les experts appellent donc à la création d’une cellule interministérielle dédiée au développement de l’esprit critique et d’une EMI (Education aux médias et à l’Information) tout public, qui associerait ministères, médias, associations, bibliothèques.

Le rapport suggère également d’élever le sujet au rang de de Grande Cause nationale et de systématiser la formation en milieu scolaire, ainsi qu’auprès des élus locaux, des collectivités locales et des responsables de bibliothèques.

La formation à la vigilance intellectuelle doit être un objectif partagé pour toute société attachée à faire vivre l’héritage du siècle des Lumières et les espoirs qu’il portait.

extrait du Rapport bronner

Adapter les outils numériques à la viralité d’Internet

Parmi les pistes avancées par les experts pour contrer les fausses informations, on peut aussi citer l‘adaptation de notre arsenal juridique. Le rapport invite à introduire un nouvel article de loi « mettant en cause la responsabilité civile des diffuseurs de mauvaise foi de fausses nouvelles pouvant porter préjudice à autrui, responsabilité qui pourrait notamment être proportionnée au niveau de viralité de la diffusion et de la popularité numérique de son auteur »

Le rapport recommande également de renforcer les moyens réagir immédiatement dès qu’une fausse information circule. Pour cela, il est recommandé de compléter l’article 17-2 de la loi du 30 septembre 1986, afin de prévoir que l’Autorité de régulation de la communication audiovisuelle et numérique (ARCOM) puisse « être saisie par toute personne ayant rencontré une difficulté pour obtenir l’intervention et la coopération d’une plateforme afin de prévenir ou stopper la diffusion massive d’un contenu susceptible de véhiculer une fausse nouvelle pouvant troubler l’ordre public, ou pour contester une décision affectant l’un de ses contenus ». Pour rappel, l’ARCOM est désormais chargée de veiller au respect par les plateformes de leurs obligations de retrait rapide de certains contenus illicites graves.

Les experts ont jugé qu’il manquait à ce jour une procédure formalisée de signalement ouverte à tout citoyen afin de faire connaître a posteriori à l’ARCOM les difficultés rencontrées dans la prise en compte de la réclamation par la plateforme ou, au contraire, les cas de retrait unilatéral d’un contenu qui ne justifiait pas une mesure aussi radicale, afin que la plateforme lui apporte une réponse appropriée.

La Commission recommande enfin d’exiger des plateformes qu’elles ouvrent l’accès à leurs données aux scientifiques.

Privilégier les contenus de qualité et refondre la logique algorithmique

Dans le combat contre la viralité des contenus de faible qualité, le rapport recommande de lutter contre les biais de popularité à travers les algorithmes. Pour cela, les plateformes sont invitées à permettre aux utilisateurs de mieux se représenter l’état du réseau et la prévalence réelle des opinions en désactivant par défaut les métriques de popularité et l’éditorialisation algorithmique, et en mettant en avant des métriques permettant de juger de la qualité épistémique des contenus (historique de partage notamment).

La mise en avant de la compétence pourrait aussi passer par la mise en avant des comptes d’experts dont le contenu serait amplifié (lorsqu’il porte sur un sujet relatif à leur expertise).

Responsabiliser les entreprises face à l’économie des infox

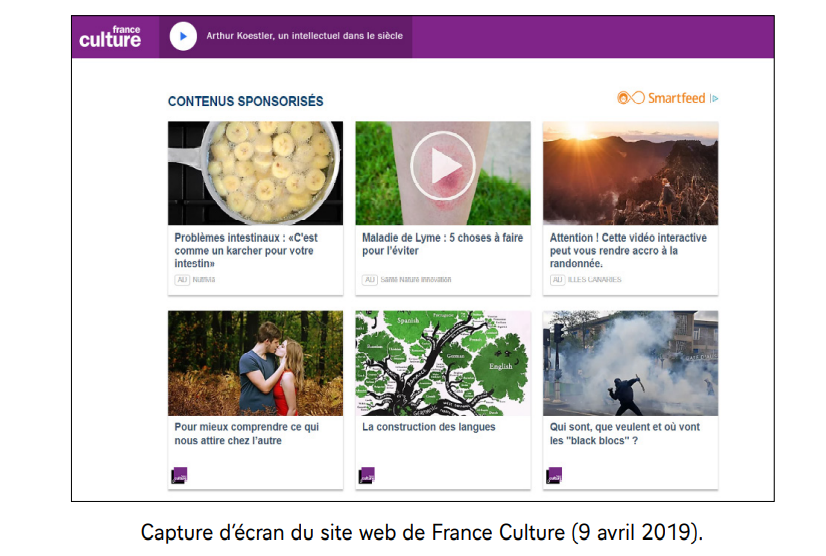

Le rapport met le doigt sur le trafic indirect généré depuis des sites de presse généralistes vers des sites «pièges à clics». Il s’agit par exemple, de contenus publicitaires sponsorisés, au contenu douteux, sur la page du site France Info.

Pour assainir l’environnement numérique, le rapport recommande de promouvoir l’investissement publicitaire responsable des entreprises en encourageant le recours, par les annonceurs, les régies, les agences publicitaires et

surtout les fournisseurs de technologie publicitaire, à des «listes d’exclusion et d’inclusion de sites web» dynamiques, telles que celles élaborées par exemple par NewsGuard, Global Disinformation Index ou Storyz.

Organiser la défense nationale contre l’ingérence numérique étrangère

Dans un chapitre très intéressant, le rapport revient sur les tentatives de déstabilisation étrangères qui ont touché les campagnes présidentielles aux États-Unis depuis 2016 mais aussi la France.

Pour faire face à ces nouvelles menaces, le rapport recommande d’agir au niveau national et international.

Pour le niveau national, il s’agit en premier lieu d’analyser les campagnes d’ingérence étrangère ayant visé la conduite de la vie démocratique française afin de mieux anticiper le risque et « de protéger l’intégrité des prochains processus électoraux« .

Elle invite aussi à mettre en place « un dispositif de coopération entre plateformes, institutions et communauté académique pour réagir rapidement aux opérations détectées » et encourage le dialogue entre gouvernement, chercheurs, plateformes et journalistes.

Au niveau international, le rapport souhaite la création d’un mécanisme de gestion de crise à l’échelle européenne pour renforcer la capacité de réaction des Etats membres en cas d’attaques. L’harmonisation au niveau international de la législation sur les obligations des plateformes est aussi souhaitée. Le rapport propose de travailler ces pistes là au sein d’un groupe de travail de l’OCDE.